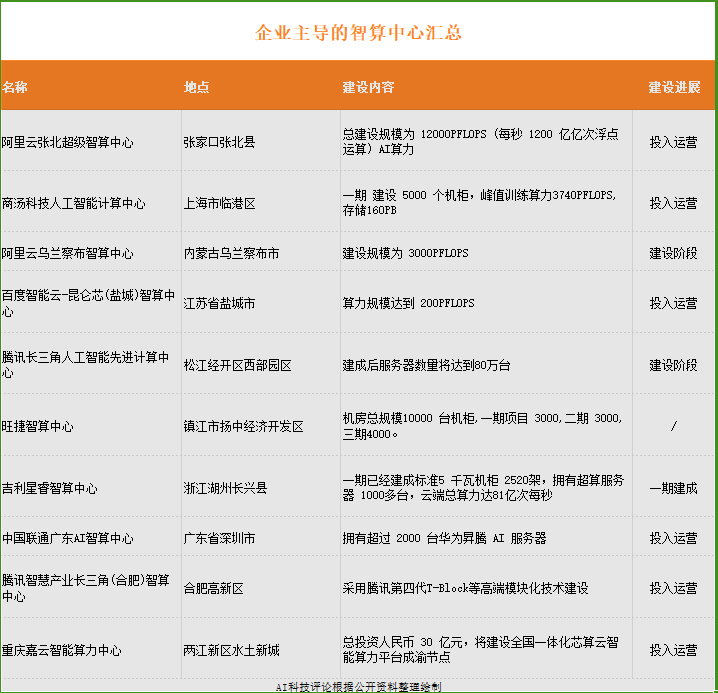

人工智能的快速发展催生了智算中心这个概念。自 2023 年下半年起,中国智能计算中心的建设速度明显提升。据不完全统计,目前已有超过30个城市投身于智算中心的建设或规划之中。一方面,随着生成式人工智能的飞速进步和对大模型需求的急剧膨胀,处理和分析海量数据所需的强大算力变得至关重要。另一方面,市场在追求规模效应的过程中,出现了盲目超前的建设和大量囤积现象,导致对需求的管理不够精细,运营过程缺乏透明度和监管,从而引发了智算中心的空转甚至停机问题。这不仅未能充分利用设备生命周期的潜在价值,还造成了资源和资金的浪费。实际上,空转率在算力行业并非鲜见,它是一个重要的指标,无论人工智能需求量大小,都需关注。即便在我们的日常生活中,家用 PC 也存在空转率问题。然而,大模型的爆炸式增长使得这一问题变得尤为关键,只是由于现在行业仍处于一卡难求的供不应求时期,它的紧迫性尚不显著。大模型加码,算力行业迎来新的机遇,在这波热潮之下,对于整个算力的部署,我们也需要一些不一样的冷思考。AI 智算中心的成立并非由大模型直接催生。事实上,在今年 ChatGPT 大火之前,国内已经有几家大型厂商相继成立了大型的 AI 计算装置,如商汤的 AI 大装置、阿里的飞天智算、百度的 AI 大底座等等。大模型前夜,这些智算中心的用途主要是小型深度学习模型的训练与推理,而大模型爆发后,万卡规模、GPU 渐为算力集群核心的特征成为新一代智算中心的挑战。人们将大模型的起步阶段比喻为“淘金期”,认为淘金浪潮下的淘金者不一定能成功淘到金、但卖铲子的人一定稳赚不赔。于是,为大模型时代建立智算中心成为今年中国科技圈的另一番火热现象。这一思路没毛病,但现实永远比理想复杂。一个少为人知的数据是,在大模型爆火之前,一些智算中心一度有价无市,如果没有模型在机器上跑,一天的闲置成本就高达十几万。换言之,大模型的爆火“救”了一部分智算中心。而高昂的空转成本背后,恰是一座 AI 智算中心高昂的运行成本。以万卡规模的智算中心为例。据 AI 科技评论与相关行业人士了解后粗略估算,运营一座能用于大模型训练与推理的万卡规模智算中心需要每年投入高达 10 亿人民币。与传统的数据中心相比,智能中心的建设对能耗和基础设施的要求更高。以算力行业常见的 42U 服务器机柜为例,传统数据中心大约会部署 20 至 30 台 CPU 服务器,而在相同空间内,若换成 GPU 服务器,则需要考虑多方面因素。多位行业人士向 AI 科技评论表示,供电、制冷和承重等多方面的限制因素共同决定了机柜内可以放置的机器数量。行业形成的共识是,大多数智算中心的一个机柜通常最多能放两台 GPU 服务器,超过四台的情况下就需要进行特殊的电力改造。标准机柜一般最多能容纳两台 8 卡的 GPU 服务器。据 AI 科技评论了解,在条件允许的情况下,大部分智算中心部署的都是市面上热捧的 DGX A100 服务器。DGX A100 服务器在发布时的售价为 19.9 万美元,折合人民币约为 140 万元。目前,其市场价格已攀升至约 170 万元。这一价格涵盖了内部配备的两个高性能 AMD 64 核霄龙处理器以及八个先进的 A100 GPU。然而,这仅仅是硬件成本的一部分。购买并安装一台 DGX A100服务器,加上存储扩充、部分备件以及调试等费用,总成本将达到 170 万元。部分服务器还具备存储扩展能力,这将进一步提高总价。按照市面上服务器的平均四年折旧期计算,每年的折旧成本约为 42.5 万元。DGX A100 服务器的最大系统功耗为 6500W,其外形尺寸为 6U。考虑到 42U 的标准机柜配置,通常一个机柜最多可以容纳两台 GPU 服务器。若超过四台服务器,则需要进行特殊的电力改造。标准机柜一般能够承载两台 8 卡的 GPU 服务器。因此,单个机柜可容纳两台 DGX A100 服务器,对应的总功耗为 13KW。假设设备全年持续运行(每天 24 小时,每年 365 天),则每年的耗电量为 13KW * 24小时/天 * 365天/年 = 113.880KW。以每度电0.54元(1度=1千瓦时,kWh)的价格计算,每年的电费为:113.880KW * 0.54元/kWh = 99,440元,接近每年10万元。在常规的互联网数据中心(IDC)中,电力消耗主要来源于 IT 设备、冷却系统、电源系统以及照明系统等。尽管不同类型的 IDC 中心电力消耗比例可能存在差异,但通常情况下,IT设备是最大的电力消耗源,约占总耗电量的50%至60%。其次为冷却系统,其电力消耗占比在 30% 至 40% 之间。电源系统和照明系统等其他设施的耗电量相对较小。基于这些数据,我们可以粗略估算出,一台全负荷运行的服务器每年的电费大约为20万元。考虑到电费通常占IDC中心运营成本的约 50%,那么该服务器一年的运行成本可能大约是电费的两倍左右,估算为 40 万元。综上所述,运营一台 DGX A100 服务器,一年的成本包括约 42.5 万元的折旧费和约 40 万元的运行电费,总计约为 82.5 万元。可以想象,一台成本如此高昂的服务器如果不能得到满打满载的利用,那么所造成的浪费不可小觑。以一个拥有万卡的厂商为例,8 卡一台服务器,相对应厂商会拥有 1250 台服务器,粗略以每台 80 万的成本来计算,一年都需要 1250*80 万也就是 10 亿的成本。在衡量大模型智算中心的建设价值时,人们常习惯举诸如高速公路、大型发电厂等基础设施的例子来辩证——虽然高速公路的建设成本高,但当在路上跑的车辆越多,成本均摊下来就越便宜。在这样的逻辑上,容易被忽视的问题是:大模型时代刚起步,大模型的原生应用还远远没有爆发,市场需求存在虚空。如果高速公路建成了、但每年跑在公路上的汽车只有数百辆,均摊成本由谁来承担?大模型仍然在发展,但 2023 年即将过去,算力中心空转率成为一个需要关注的问题。一位算力从业者在参观某市的一个大型智算中心时发现,虽然占了一个山头写着“**中心”,但实际上每年固定投入3000万,但机房内只有不到100个有机架式服务器,很多服务器都是空转。而据 AI 科技评论了解,该现象不是孤例。当面临巨大的算力需求时,智算相应的基础设施建设成本会不可避免地增加。另一方面,对于市场实际需求把握不够精准也会造成智算中心建设后,服务器上架率却达不到理想状态。沙利文的数据显示,2022 年中国数据中心的上架率大约为 58%,这意味着在数据中心中,大约有 58% 的服务器被摆放到机柜上并投入使用,而剩下的 42% 的机柜可能是空的,即尚未被服务器占用。造成算力中心空转的原因主要有两块,一块是技术上的不成熟,另一块则是市场需求的认知偏差。技术上,无论是英伟达的计算卡还是国内某些品牌的芯片,在长时间运行过程中,都可能会出现故障,如突然掉卡等问题。一位云计算行业的专业人士告诉AI科技评论,他在最近的一次会议上得知,某国产知名 AI 芯片在训练30天后可能会完全报废。此外,由于芯片的更新换代周期性,芯片制造商不断推出新产品,几年后,新一代服务器将成为市场主流,导致部分服务器不得不被废弃或闲置。国内大型智算中心厂商表示,算力资源的利用率的确会出现高峰和低谷,在需求旺盛的时候,利用率可能达到 80% 到 90%,空转率在那些时候会相对较低,大约在 10% 到 20% 之间波动。在尖峰时刻,计算资源可能会被充分利用,空转率才会降低。而从应用端而言,据 AI 科技评论了解,现如今底层模型端的需求主要是用于训练,但大模型发展至今,真正的杀手级 AI 原生应用却迟迟未见踪影,当前中国的大模型原生应用数量远远没有达到大众预期。数据显示,截至10月份,国内已经发布了238个大模型,相较于6月份的79个,在四个月内增长三倍,但相较于国外的几十个基础大模型和上千个AI原生应用来看,国内AI原生应用数量却很少。基于现有基座大模型推出的 AI 原生应用并没有大面积爆发,也就是说DGX 服务器基本还是用于基座模型的训练,还没有用于实际的推理端。这就好比我们在前文提及的高速公路建设,建成了,前期虽有200多车辆来平摊成本,但是一旦训练需求下降,后续没有原生应用,如此高昂的成本便成为了实打实的浪费。在如今应用侧还没有完全起来的情况下,智算中心空转成本,仍是一个显著问题。以某AI公司发表的财报为例,2023 年上半年期内销售成本大幅增长近63%,达到78亿4千万人民币;其中占比达82%的硬件成本及分包服务费同比增长54%,另外两块成本——AI数据中心(AIDC)运营和折旧摊销成本也分别暴增75%、562%,但该公司AI营收却微,上半年生成式AI相关收入仅约为2.91亿元。而AI 原生应用爆发后的效果,以 ChatGPT 为例,在 ChatGPT(GPT3.5和GPT4)下每个单词大概消耗1.12个token,官方计费标准为 $0.002 / 1k tokens,在英语中“一个 token 通常对应大约 4 个字符”,而1个汉字大致是2~2.5个token。1000 tokens大概是750单词。那也就是说,大概2美元可以问100万个token,相当于750000个单词。日常我们使用基本问清楚1个问题就要耗费100~200个token,以ChatGPT的1亿月活用户的来算,算下来一个月至少得花200万美元。若月活用户持续增多或者当用户规模进一步扩大,调用API带来的运算和效益会更加巨大。一个AI 应用尚且能获得如此大的收入,而当行业不再只有200个基座大模型,而是几百上千个AI应用出现时,巨额的算力成本或许也就有法可解了。所以,只有当更多切实有效的大模型应用场景得以发掘,或是关键技术实现重大突破时,这些闲置的资源才可能被重新激活。当大模型热潮兴起时,人们常常将其比喻为电力。业内也有非常的多的模式来优化算力资源的调度。一行业人士告诉 AI 科技评论,一些厂商正在研发GPU服务,采用类似service的架构。尽管实现方式各异,但大家的目标是一致的:希望能够按照客户实际的使用量来计算费用,就像使用水电一样——按用量计费。算力池化是一种做法,池化顾名思义,就是把这些智算中心、资产中心里面的这些 AI 芯片、 AI 加速器,池化完了之后,然后,通过网络为需要计算资源的上层应用提供服务。这意味着应用可以根据需要提取资源,使用时即时获取,用完后归还到资源池中。而另一方面,智算中心的高效运营本身就离不开技术层面其余 IT 能力的提升。行业人士告诉AI科技评论,对于一个专业的智算中心而言,冗余和备用方案是至关重要的,以便在某个组件或资源出现故障时,其他资源可以自动接管,从而实现无缝切换,减少服务中断的时间。另一方面,数据中心的运营还非常依赖于人员的技术能力。数据中心不仅需要提供计算资源,还需要提供技术支持和专业服务。而纵观整个行业,在大模型技术的席卷之下,当前对算力资源的精细化管理仍显得相对滞后。尽管紧跟行业趋势、积极布局大模型战略对于企业来说无可非议,但就如同在一架全速飞行的飞机上,必须时刻警醒并密切关注那些可能潜藏风险的关键部件一样,对于算力基础设施的关注与优化同样至关重要。前瞻性地规划三步之遥,深度思考一步之内,方能在创新竞赛中领先半步。实际上,现在行业已经意识到AI应用的开发与突破是下一步人工智能从理论层面步入实践领域,并形成其价值转化的关键节点。此前,百度李彦宏就曾点出,在基础模型之上,要有千千万万甚至数以百万计的 AI 原生应用,这个大模型的价值才能被体现出来。而从根本上讲,要解决智算中心资源利用率不高的实质性问题,关键也在于如何积极引导并推动大模型应用的广泛普及与深度整合,确保计算设施能够精准匹配真实世界的需求,实现高效、有序的运行状态。通过大模型应用的全面开花,不仅可以有效利用现有智算中心的强大算力,还能进一步推动人工智能技术与实体经济的深度融合,释放更大的创新活力与价值潜力。从这一层面而言,如今面对智算中心潜在的空转问题所带来的冷思考,并非仅是对既有认知的简单颠覆,更可能是关乎重大风险预警的“灰犀牛”现象。关注公众号:拾黑(shiheibook)了解更多

[广告]赞助链接:

四季很好,只要有你,文娱排行榜:https://www.yaopaiming.com/

让资讯触达的更精准有趣:https://www.0xu.cn/

关注网络尖刀微信公众号

关注网络尖刀微信公众号

![张星星ztar最近在看老友记了[兔子] 沉迷各种美剧中[掌宝荧光棒] ](https://imgs.knowsafe.com:8087/img/aideep/2021/8/12/ae9d097c34e573af338390da1841430c.jpg?w=250)

大数据文摘

大数据文摘