卷积神经网络中十大拍案叫绝的操作

作者 | Justin ho

来源 | 机器学习算法那些事

从2012年的AlexNet发展至今,科学家们发明出各种各样的CNN模型,一个比一个深,一个比一个准确,一个比一个轻量。我下面会对近几年一些具有变革性的工作进行简单盘点,从这些充满革新性的工作中探讨日后的CNN变革方向。

卷积只能在同一组进行吗?

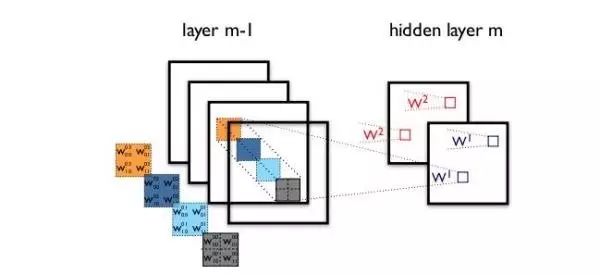

-- Group convolution

Group convolution 分组卷积,最早在AlexNet中出现,由于当时的硬件资源有限,训练AlexNet时卷积操作不能全部放在同一个GPU处理,因此作者把feature maps分给多个GPU分别进行处理,最后把多个GPU的结果进行融合。

AlexNet

分组卷积的思想影响比较深远,当前一些轻量级的SOTA(State Of The Art)网络,都用到了分组卷积的操作,以节省计算量。但题主有个疑问是,如果分组卷积是分在不同GPU上的话,每个GPU的计算量就降低到 1/groups,但如果依然在同一个GPU上计算,最终整体的计算量是否不变?找了pytorch上有关组卷积操作的介绍,望读者解答我的疑问。

pytroch github

EDIT:

关于这个问题,知乎用户朋友 @蔡冠羽 提出了他的见解:

我感觉group conv本身应该就大大减少了参数,比如当input channel为256,output channel也为256,kernel size为3*3,不做group conv参数为256*3*3*256,若group为8,每个group的input channel和output channel均为32,参数为8*32*3*3*32,是原来的八分之一。这是我的理解。

我的理解是分组卷积最后每一组输出的feature maps应该是以concatenate的方式组合,而不是element-wise add,所以每组输出的channel是 input channels / #groups,这样参数量就大大减少了。

卷积核一定越大越好?-- 3×3卷积核

AlexNet中用到了一些非常大的卷积核,比如11×11、5×5卷积核,之前人们的观念是,卷积核越大,receptive field(感受野)越大,看到的图片信息越多,因此获得的特征越好。虽说如此,但是大的卷积核会导致计算量的暴增,不利于模型深度的增加,计算性能也会降低。于是在VGG(最早使用)、Inception网络中,利用2个3×3卷积核的组合比1个5×5卷积核的效果更佳,同时参数量(3×3×2+1 VS 5×5×1+1)被降低,因此后来3×3卷积核被广泛应用在各种模型中。

每层卷积只能用一种尺寸的卷积核?

-- Inception结构

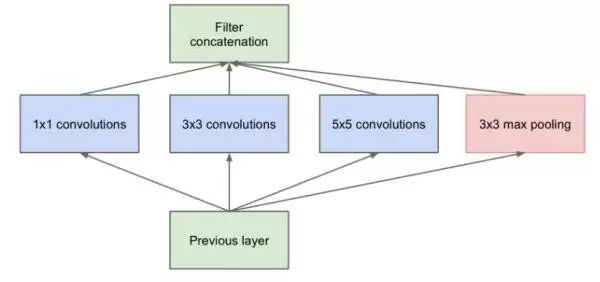

传统的层叠式网络,基本上都是一个个卷积层的堆叠,每层只用一个尺寸的卷积核,例如VGG结构中使用了大量的3×3卷积层。事实上,同一层feature map可以分别使用多个不同尺寸的卷积核,以获得不同尺度的特征,再把这些特征结合起来,得到的特征往往比使用单一卷积核的要好,谷歌的GoogLeNet,或者说Inception系列的网络,就使用了多个卷积核的结构:

最初版本的Inception结构

如上图所示,一个输入的feature map分别同时经过1×1、3×3、5×5的卷积核的处理,得出的特征再组合起来,获得更佳的特征。但这个结构会存在一个严重的问题:参数量比单个卷积核要多很多,如此庞大的计算量会使得模型效率低下。这就引出了一个新的结构:

怎样才能减少卷积层参数量?

-- Bottleneck

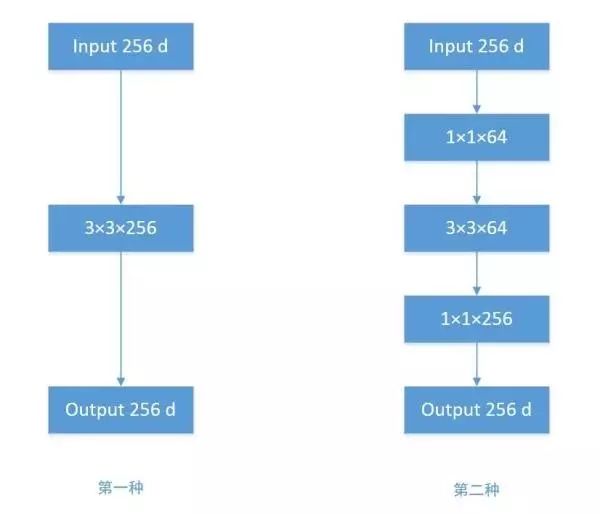

发明GoogleNet的团队发现,如果仅仅引入多个尺寸的卷积核,会带来大量的额外的参数,受到Network In Network中1×1卷积核的启发,为了解决这个问题,他们往Inception结构中加入了一些1×1的卷积核,如图所示:

加入1×1卷积核的Inception结构

根据上图,我们来做个对比计算,假设输入feature map的维度为256维,要求输出维度也是256维。有以下两种操作:

256维的输入直接经过一个3×3×256的卷积层,输出一个256维的feature map,那么参数量为:256×3×3×256 = 589,824 256维的输入先经过一个1×1×64的卷积层,再经过一个3×3×64的卷积层,最后经过一个1×1×256的卷积层,输出256维,参数量为:256×1×1×64 + 64×3×3×64 + 64×1×1×256 = 69,632。足足把第一种操作的参数量降低到九分之一!

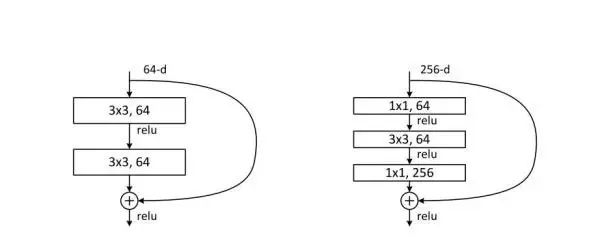

越深的网络就越难训练吗?

-- ResNet残差网络

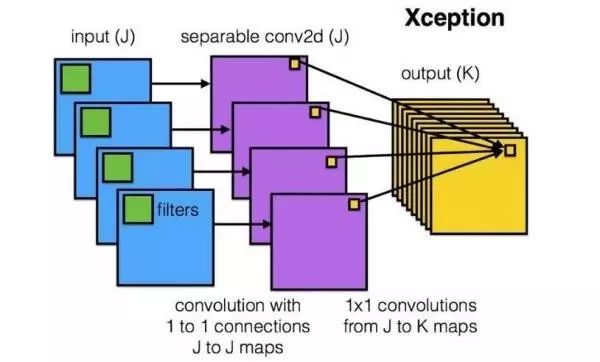

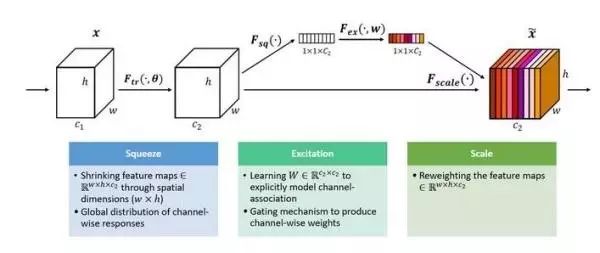

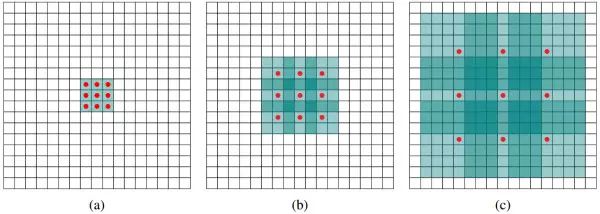

卷积操作时必须同时考虑通道和区域吗?

-- DepthWise操作

-- SEnet

启发与思考

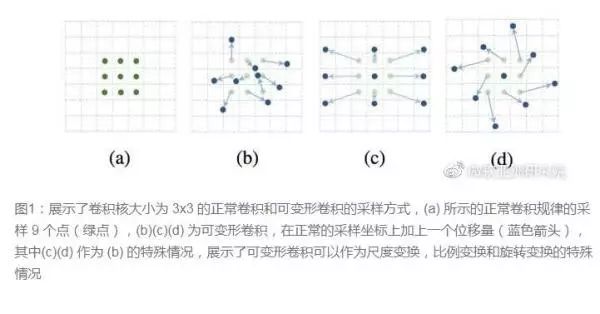

大卷积核用多个小卷积核代替; 单一尺寸卷积核用多尺寸卷积核代替; 固定形状卷积核趋于使用可变形卷积核; 使用1×1卷积核(bottleneck结构)。

标准卷积用depthwise卷积代替; 使用分组卷积; 分组卷积前使用channel shuffle; 通道加权计算。

使用skip connection,让模型更深; densely connection,使每一层都融合上其它层的特征输出(DenseNet)

【end】

◆

精彩推荐

◆

推荐阅读

你点的每个“在看”,我都认真当成了AI

关注公众号:拾黑(shiheibook)了解更多

[广告]赞助链接:

四季很好,只要有你,文娱排行榜:https://www.yaopaiming.com/

让资讯触达的更精准有趣:https://www.0xu.cn/

关注网络尖刀微信公众号

关注网络尖刀微信公众号随时掌握互联网精彩

- 1 中法元首相会都江堰 7904409

- 2 对日斗争突发新情况 7808365

- 3 海军、国防部、外交部 严正批驳×3 7713490

- 4 国际机构看中国经济 关键词亮了 7617731

- 5 国乒击败日本后齐唱《义勇军进行曲》 7519950

- 6 父亲工资打孩子账户致儿子无法考公 7427929

- 7 净网:网民造谣汽车造成8杀被查处 7331048

- 8 中国女游客度假时从酒店9楼坠亡 7236179

- 9 12306出新功能了 7137932

- 10 千吨级“巨无霸”就位 7047433

![大爱EXIST947947做一个洒脱自信的女人 [开心] [绿植乖巧] ](https://imgs.knowsafe.com:8087/img/aideep/2025/9/19/94cab800849cb5ba357be7e9a4524cf2.jpg?w=250)

AI100

AI100