来源:ICML 2021

编辑:LRS

【新智元导读】Transformer能处理文字、图片,如今又进军视频领域!Bengio的徒孙、罗格斯大学华人博士生发布了一个视频版GPT-3,基于Transformer的视频生成器,ICML 2021已发表。

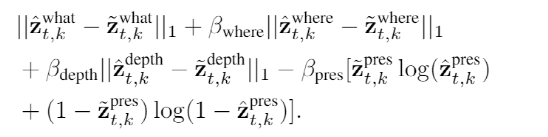

Transformer已经成了当下「最牛」的基础模型,在NLP、CV领域无往而不利。一些基于Transformer预训练模型BERT、GPT对于下游任务,如问答、阅读理解、文本摘要等都有很好的促进作用。GPT主要关注文本生成,并且取得了不错的成就,但到目前为止,视频生成还没有一个很完善的预训练模型。基于Transformer的视频生成中,主要难点在于:2、如何序列化这些分隔后的片段(token)。与文本中的token不同,文本的符号是自然有序的。之前对图像和视频的相关工作主要是在像素级别进行操作,将图像平坦化(flatten out)为像素序列。然而,由于Transformer中使用的自注意层的存储和计算在输入序列长度上是二次复杂度的,为了有效地训练这些模型,这些工作要么降低图像的分辨率,要么在整个图像或视频中使用局部注意而不是全局注意力。针对这个问题,罗格斯大学的博士生Yi-Fu Wu提出了一个新模型OCVT,以对象为中心的表示与使用自回归对象级下一帧预测目标训练的Transformer相结合,论文已经发表在ICML 2021上了。他是斯坦福大学的理学硕士和伊利诺伊大学厄巴纳-香槟分校的理学学士,最近的研究主要关注非监督表征学习。他的导师是Sungjin Ahn,曾经在MILA的 Yoshua Bengio 收下做过深度学习的博士后。他是罗格斯大学认知科学计算机科学中心的助理教授,领导着罗格斯大学的机器学习小组。主要研究目标是解决核心机器学习问题,开发通用的问题解决代理。特别强调无监督和结构化学习的世界模型和表示使用深度学习,概率学习,和强化学习。也喜欢从认知科学和神经科学中得到启发,去寻找新奇的问题和适当的归纳偏见。他在加州大学欧文分校获得了博士学位,在 Max Welling 教授的指导下研究可扩展的近似贝叶斯推断。在这篇论文中,研究人员提出了一种不同的方法来解决Transformer中自注意力二次时间复杂度。在对象级(object)粒度上平衡归纳偏见(inductive bias),对于许多下游任务是有益的,特别是在对象相互作用的场景中。为此,他们研究了标记化和序列化视频的不同设计选择,并提出了以对象为中心的视频转换器(Object-Centric Video Transformer, OCVT)。在OCVT中,将以对象为中心的表示与使用自回归对象级下一帧预测目标训练的Transformer相结合。模型利用了一类以对象为中心的潜在表示,它可以学习结构化表示而无需对象级标记。所学习的对象表示包括关于每个视频帧中的对象的显式位置和大小信息。用它来寻找两帧之间物体的二部匹配,这样就可以构造面向对象的损失函数。以对象为中心的Transformer的使用允许OCVT学习视频中对象之间的空间和长期时间交互。解码器使用一系列反褶积层(deconvolution layer)为每个对象创建图像。z^(pres)用于确定对象的透明度,一个较低的值将导致对象不出现在重建图像中。然后将空间Transformer与z^(where)一起使用,将每个对象放置到最终重建图像上。对于背景不能完全被物体覆盖的场景,还训练了一个完全卷积的背景模块来生成背景隐藏z^g。在这种情况下,还生成一个前景遮罩α,用于控制最终渲染图像中前景对象和背景之间的权重。为了建模对象随时间的动态性,使用了一个Transformer解码器,其中的输入是以对象为中心的隐向量z^t。与其他模型使用RNN相比,Transformer既能建模时间的动态性,并且也不要求一个分离的交互式模型。除此之外,尽管RNN能够保存过去状态的隐藏层,但Transformer直接访问过去的隐藏层,显然能够更直接地建模长距离的词依赖。除此之外,研究人员还对时间步长t使用正弦编码,类似于原始Transformer(Attention is All you Need论文中说的)中的位置编码作为Transformer解码器的输入。而且他们对传统transformer解码器中的因果注意遮罩(casual attention mask)进行了改进,使得一个时间步长内的对象可以相互产生注意。当一个物体在图像中移动时,它可能会在不同的时间步被不同的网格单元检测到,因为在帧之间使用了object-wise loss,所以还需要进行模型对齐(object alignment)。也就是说,需要VAE推断的隐向量z^t中的对象与transformer预测的隐向量具有相同的顺序。需要注意的是,Transformer的输入不需要跨时间步对齐,因为面向对象的自注意力作用于一组无顺序的对象。对齐主要使用1955年提出的Hungarian算法。(3) 模型能否提供良好的表示,以便在下游任务中使用(4) 设计选择的有效性,及有效的程度,包括以对象为中心的表示、用于动力学预测的Transformer、场景预测与自回归组件预测从下表可以看到OCVT在所有四个数据集上都达到了最高的精度。ConvVT在Mod1数据集上也有很好的表现,但是在其他需要长期依赖关系的数据集上,精确度会下降。这表明了在对象级时空交互建模中使用以对象为中心的表示的有效性。此外,还应注意到基于RNN的模型(GSWM和LSTM+GNN)的模拟性能下降,这表明使用RNN对非常长期的依赖关系进行建模的局限性。自回归生成场景的模型(OCVT-AR和ConvVT-AR)的性能不如非自回归模型。尤其是convt-AR,似乎根本无法正确地对这项任务进行建模,其精确度低于random(0.2,5列)。这可能是因为在这些模型中生成单个图像需要多次通过变换器,并且任何预测误差都可能是复合的。此外,OCVT-AR需要模型根据对象的位置正确地学习对象的顺序,这可能不是一项容易的任务。为了强调前期轨迹,像素MSE评价指标是最具信息性的,绘制评价曲线直到它们变平,而不是到达轨迹的末端。可以注意到GSWM在这种设置下获得了最佳的平均欧氏距离和像素MSE。这并不奇怪,因为GSWM的object-RNN只编码一个球的轨迹,与其他对象的动力学无关。由于动力学的预测只依赖于最后几个时间步,因此不需要对长期依赖性进行建模。交互作用是由一个单独的图形神经网络处理,也很好地从轨迹建模分离。另一方面,OCVT需要学习执行更复杂的操作,即在考虑交互的同时分解出自己的轨迹。此外,由于GSWM是端到端训练的,因此它能捕捉到潜变量中的动力学信息,有助于进行轨迹预测。有趣的是,尽管如此,OCVT仍然可以合理地学习动态,优于其他基线。此外,GSWM的训练程序相比OCVT需要四倍长的时间来收敛,这也会导致不稳定的训练,尤其是对于较长的轨迹,Mod1234实验证明了GSWM不能很好地学习动力学。下图显示了Mod1数据集上不同模型的长距离生成结果。图中显示了前20个预测step,可以看到GSWM预测的球的位置非常接近地面真实情况,但是在预测球的颜色变化时会出现一些错误。例如,在第7帧中,它错误地预测紫色球应该变成黄色而不是青色。类似地,LSTM+GNN和ConvVT错误地预测了球的颜色(例如,对于LSTM+GNN,第10帧处的紫色球和对于ConvVT,第10帧处的蓝色球),同时也具有比GSWM更差的动力学预测。SVVT的动力学性能甚至比其他模型差,而且还可以预测混合颜色的球。ConvVT-AR预测在几帧之后丢失的球,结果在比其他模型更低的像素MSE处出现平台,即使生成明显不正确。OCVT-AR比地面真帧更早预测颜色变化,因为不准确的动力学以及不正确的颜色变化(例如第14帧中的紫罗兰球)

参考资料:

https://arxiv.org/abs/2107.09240

关注公众号:拾黑(shiheibook)了解更多

[广告]赞助链接:

四季很好,只要有你,文娱排行榜:https://www.yaopaiming.com/

让资讯触达的更精准有趣:https://www.0xu.cn/

关注网络尖刀微信公众号

关注网络尖刀微信公众号

新智元

新智元