极验验证:浅析深度学习模型与应用

哈喽,亲爱的小伙伴们,很久之前极小验和大家分享了文章《深度学习发展史》,不知道大家还记不记得,不过记不得也没有关系呀,可以戳链接再看一遍。既然了解了深度学习发展史,那么今天极小验就带大家来看一看深度学习的应用现状。

2006年Geoffery Hinton提出了深度学习(多层神经网络),并在2012年的ImageNet竞赛中有非凡的表现,以15.3%的Top-5错误率夺魁,比利用传统方法的第二名低了10.9% 。一时之间,深度学习备受追捧。Google、Facebook、百度等等公司纷纷开始大量的投入深度学习的应用研究。

深度学习的优势

人工神经网络是从信息处理的角度,对人脑神经元网络进行抽象的计算模型,目的就是让计算机能够模拟人脑的思考方式来解决一些抽象的问题。相比较于传统的模式识别,特征的提取方式主要靠人工提取或设计,而深度学习模型是一种端到端模型,即让计算机自动学习有用的特征,从而减少了人为提取特征造成的繁杂和不完备性。正如Google Brain项目负责人Jeff Dean说:“我们在训练的时候从来不会告诉机器说:‘这是一只猫。’系统其实是自己发明或者领悟了“猫”的概念。”在图像处理,语音识别这种人为特征提取难度很大的问题上面,深度学习有着其独有的优势,比如在语音识别方面,深度学习使得错误率下降了大约30%,取得了很大的进步。

深度学习的主要模型

目前深度学习有三种基本模型,分别是多层感知机(MLP,Multi-layer Perceptron),卷积神经网络(Convolutional Neural Network)以及循环神经网络(Recurrent Neural Network)。

多层感知机(MLP)

2006年Geoffery Hinton提出了深度学习(多层神经网络),并在2012年的ImageNet竞赛中有非凡的表现,以15.3%的Top-5错误率夺魁,比利用传统方法的第二名低了10.9% 。一时之间,深度学习备受追捧。Google、Facebook、百度等等公司纷纷开始大量的投入深度学习的应用研究。

深度学习的优势

人工神经网络是从信息处理的角度,对人脑神经元网络进行抽象的计算模型,目的就是让计算机能够模拟人脑的思考方式来解决一些抽象的问题。相比较于传统的模式识别,特征的提取方式主要靠人工提取或设计,而深度学习模型是一种端到端模型,即让计算机自动学习有用的特征,从而减少了人为提取特征造成的繁杂和不完备性。正如Google Brain项目负责人Jeff Dean说:“我们在训练的时候从来不会告诉机器说:‘这是一只猫。’系统其实是自己发明或者领悟了“猫”的概念。”在图像处理,语音识别这种人为特征提取难度很大的问题上面,深度学习有着其独有的优势,比如在语音识别方面,深度学习使得错误率下降了大约30%,取得了很大的进步。

深度学习的主要模型

目前深度学习有三种基本模型,分别是多层感知机(MLP,Multi-layer Perceptron),卷积神经网络(Convolutional Neural Network)以及循环神经网络(Recurrent Neural Network)。

多层感知机(MLP)

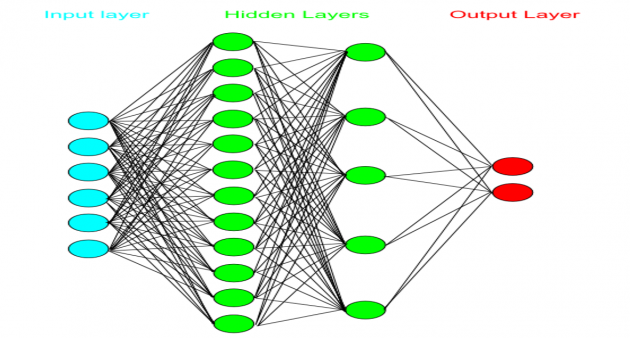

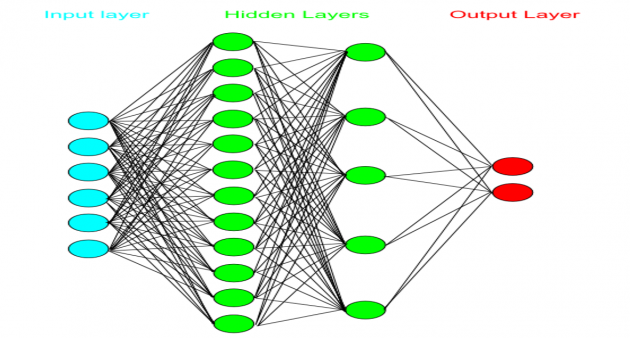

MLP结构特点

• 输入与输出层之间存在一个或多个隐层

• 输入层没有计算节点,只用于获得外部输入信号,只有隐层和输出层的神经元为计算节点

• 每个输入节点将上一层输出进行加权,然后通过激活函数进行非线性变换

训练方法:反向传播算法(Back-Propagation)

MLP可用于解决简单的分类和预测问题。不过它的参数量随着层数的增加指数级增长,并且优化困难,限制了它的应用。

卷积神经网络(CNN)

MLP结构特点

• 输入与输出层之间存在一个或多个隐层

• 输入层没有计算节点,只用于获得外部输入信号,只有隐层和输出层的神经元为计算节点

• 每个输入节点将上一层输出进行加权,然后通过激活函数进行非线性变换

训练方法:反向传播算法(Back-Propagation)

MLP可用于解决简单的分类和预测问题。不过它的参数量随着层数的增加指数级增长,并且优化困难,限制了它的应用。

卷积神经网络(CNN)

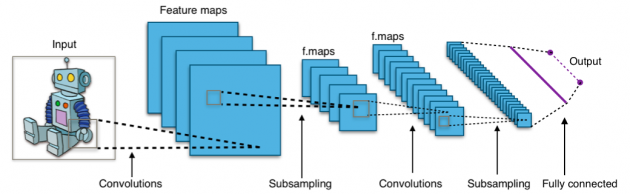

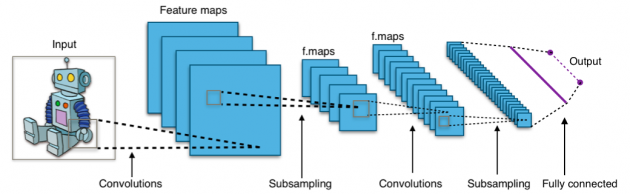

CNN通过引入卷积自动分层提取特征,每一层由多个特征图组成,每一个特征图是由前一层输出与一个卷积核进行卷积运算和非线性变换得到,随后进行池化操作,用于降低输出维度,同时获得一定的特征不变性。

CNN中最主要的三种网络层:

CNN通过引入卷积自动分层提取特征,每一层由多个特征图组成,每一个特征图是由前一层输出与一个卷积核进行卷积运算和非线性变换得到,随后进行池化操作,用于降低输出维度,同时获得一定的特征不变性。

CNN中最主要的三种网络层:

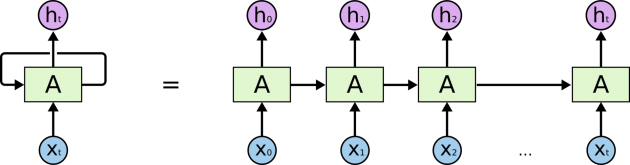

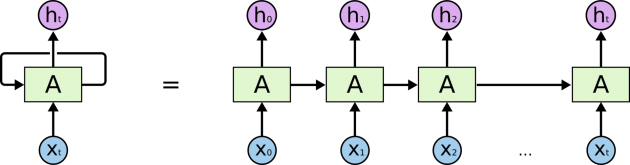

相比于MLP和CNN,RNN通过权值共享使其能够处理变长的序列问题(CNN由于全连接层需要固定维度的输入,限制了CNN只能接受固定维度的输入)。RNN引入了“环”的结构,某一时刻的输出不仅与当前时刻的输入有关,还与前一时刻的状态有关,通过共享权值,使得RNN能学习到鲁棒的特征。

RNN分类(按照cell):

相比于MLP和CNN,RNN通过权值共享使其能够处理变长的序列问题(CNN由于全连接层需要固定维度的输入,限制了CNN只能接受固定维度的输入)。RNN引入了“环”的结构,某一时刻的输出不仅与当前时刻的输入有关,还与前一时刻的状态有关,通过共享权值,使得RNN能学习到鲁棒的特征。

RNN分类(按照cell):

2006年Geoffery Hinton提出了深度学习(多层神经网络),并在2012年的ImageNet竞赛中有非凡的表现,以15.3%的Top-5错误率夺魁,比利用传统方法的第二名低了10.9% 。一时之间,深度学习备受追捧。Google、Facebook、百度等等公司纷纷开始大量的投入深度学习的应用研究。

深度学习的优势

人工神经网络是从信息处理的角度,对人脑神经元网络进行抽象的计算模型,目的就是让计算机能够模拟人脑的思考方式来解决一些抽象的问题。相比较于传统的模式识别,特征的提取方式主要靠人工提取或设计,而深度学习模型是一种端到端模型,即让计算机自动学习有用的特征,从而减少了人为提取特征造成的繁杂和不完备性。正如Google Brain项目负责人Jeff Dean说:“我们在训练的时候从来不会告诉机器说:‘这是一只猫。’系统其实是自己发明或者领悟了“猫”的概念。”在图像处理,语音识别这种人为特征提取难度很大的问题上面,深度学习有着其独有的优势,比如在语音识别方面,深度学习使得错误率下降了大约30%,取得了很大的进步。

深度学习的主要模型

目前深度学习有三种基本模型,分别是多层感知机(MLP,Multi-layer Perceptron),卷积神经网络(Convolutional Neural Network)以及循环神经网络(Recurrent Neural Network)。

多层感知机(MLP)

2006年Geoffery Hinton提出了深度学习(多层神经网络),并在2012年的ImageNet竞赛中有非凡的表现,以15.3%的Top-5错误率夺魁,比利用传统方法的第二名低了10.9% 。一时之间,深度学习备受追捧。Google、Facebook、百度等等公司纷纷开始大量的投入深度学习的应用研究。

深度学习的优势

人工神经网络是从信息处理的角度,对人脑神经元网络进行抽象的计算模型,目的就是让计算机能够模拟人脑的思考方式来解决一些抽象的问题。相比较于传统的模式识别,特征的提取方式主要靠人工提取或设计,而深度学习模型是一种端到端模型,即让计算机自动学习有用的特征,从而减少了人为提取特征造成的繁杂和不完备性。正如Google Brain项目负责人Jeff Dean说:“我们在训练的时候从来不会告诉机器说:‘这是一只猫。’系统其实是自己发明或者领悟了“猫”的概念。”在图像处理,语音识别这种人为特征提取难度很大的问题上面,深度学习有着其独有的优势,比如在语音识别方面,深度学习使得错误率下降了大约30%,取得了很大的进步。

深度学习的主要模型

目前深度学习有三种基本模型,分别是多层感知机(MLP,Multi-layer Perceptron),卷积神经网络(Convolutional Neural Network)以及循环神经网络(Recurrent Neural Network)。

多层感知机(MLP)

MLP结构特点

• 输入与输出层之间存在一个或多个隐层

• 输入层没有计算节点,只用于获得外部输入信号,只有隐层和输出层的神经元为计算节点

• 每个输入节点将上一层输出进行加权,然后通过激活函数进行非线性变换

训练方法:反向传播算法(Back-Propagation)

MLP可用于解决简单的分类和预测问题。不过它的参数量随着层数的增加指数级增长,并且优化困难,限制了它的应用。

卷积神经网络(CNN)

MLP结构特点

• 输入与输出层之间存在一个或多个隐层

• 输入层没有计算节点,只用于获得外部输入信号,只有隐层和输出层的神经元为计算节点

• 每个输入节点将上一层输出进行加权,然后通过激活函数进行非线性变换

训练方法:反向传播算法(Back-Propagation)

MLP可用于解决简单的分类和预测问题。不过它的参数量随着层数的增加指数级增长,并且优化困难,限制了它的应用。

卷积神经网络(CNN)

CNN通过引入卷积自动分层提取特征,每一层由多个特征图组成,每一个特征图是由前一层输出与一个卷积核进行卷积运算和非线性变换得到,随后进行池化操作,用于降低输出维度,同时获得一定的特征不变性。

CNN中最主要的三种网络层:

CNN通过引入卷积自动分层提取特征,每一层由多个特征图组成,每一个特征图是由前一层输出与一个卷积核进行卷积运算和非线性变换得到,随后进行池化操作,用于降低输出维度,同时获得一定的特征不变性。

CNN中最主要的三种网络层:

- 卷积层

- 池化层

- 全连接层

相比于MLP和CNN,RNN通过权值共享使其能够处理变长的序列问题(CNN由于全连接层需要固定维度的输入,限制了CNN只能接受固定维度的输入)。RNN引入了“环”的结构,某一时刻的输出不仅与当前时刻的输入有关,还与前一时刻的状态有关,通过共享权值,使得RNN能学习到鲁棒的特征。

RNN分类(按照cell):

相比于MLP和CNN,RNN通过权值共享使其能够处理变长的序列问题(CNN由于全连接层需要固定维度的输入,限制了CNN只能接受固定维度的输入)。RNN引入了“环”的结构,某一时刻的输出不仅与当前时刻的输入有关,还与前一时刻的状态有关,通过共享权值,使得RNN能学习到鲁棒的特征。

RNN分类(按照cell):

- 简单RNN

- LSTM

- GRU

- Bi-RNN

关注公众号:拾黑(shiheibook)了解更多

[广告]赞助链接:

四季很好,只要有你,文娱排行榜:https://www.yaopaiming.com/

让资讯触达的更精准有趣:https://www.0xu.cn/

关注网络尖刀微信公众号

关注网络尖刀微信公众号随时掌握互联网精彩

赞助链接

排名

热点

搜索指数

- 1 从“水之道”感悟“国之交” 7904211

- 2 日方挑衅中国收割民意非常危险 7808638

- 3 课本上明太祖画像换了 7714133

- 4 全国冰雪季玩法大盘点 7619018

- 5 日本记者街头采访找不到中国游客 7520077

- 6 20多岁女生靠偷快递为生 7425651

- 7 净网:网民造谣汽车造成8杀被查处 7331437

- 8 苟仲文受贿2.36亿余元一审被判死缓 7235359

- 9 退学北大考上清华小伙被欠家教费 7135915

- 10 流感自救抓住“黄金48小时” 7040192

极验验证

极验验证