如何提升深度学习算法效率,谷歌有这些绝招

选自谷歌博客

机器之心编译

编辑:铭怿

大型机器学习模型在多个领域展现出具有变革性的结果,但在现实世界中,训练和推理效率正在成为关键需求。Google Research 一直在通过开发新的基础技术来提高大型 ML 模型的效率。本文中,谷歌以「提升模型效率」为主题,介绍如何使 ML 模型更加强韧、高效。

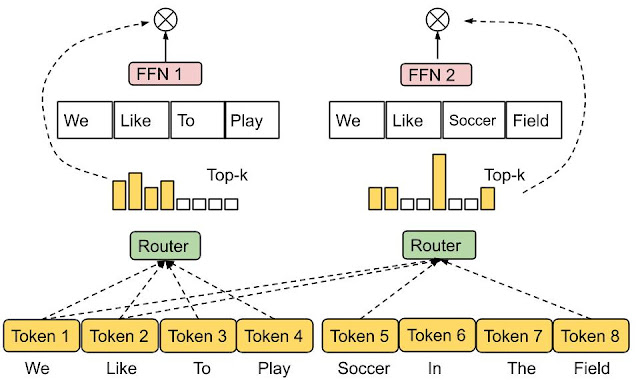

GLaM 体系架构中的每个输入 token 被动态路由到 64 个专家网络中的两个进行预测。

Transformer 是当下正火热的序列到序列模型,在从视觉到自然语言理解等一系列具有挑战性的问题上取得了显著的成功。这种模型的核心组成部分是注意力层,它识别查询和键之间的相似性,并使用这些相似性构造一个适当的值加权组合。虽然性能强,但注意力机制的计算效率却不高,复杂度通常为输入序列长度的二次方。

随着 Transformer 规模的不断增长,其中一个问题的研究十分有价值,即是否有任何自然发生的结构或模式的学习模型,可以破解注意力有效的原理。为此,研究人员研究了中间 MLP 层中的学习嵌入,并且发现它们非常稀疏 —— 例如,T5-Large 模型有 1% 的非零项。稀疏性进一步表明,人们可以在不影响模型性能的情况下潜在地降低 FLOPs。

论文地址:https://arxiv.org/pdf/2210.06313.pdf

最近,有研究推出 Treeformer—— 一种依赖于决策树的标准注意力计算的替代方案。简单来说,这可以快速识别与查询相关的键的一小部分,并且只对该集合执行注意力操作。根据经验,Treeformer 可以将注意力层的 FLOPs 降低 30 倍。除此之外还有序列注意力 —— 一种结合了注意力和贪婪算法的可微分特征选择方法。该技术对线性模型有很强的可证明保证,并可无缝扩展到大型嵌入模型。

另一种提高 Transformer 效率的方法是在注意力层中加速 softmax 计算。在「low-rank approximation of the softmax kernel」研究基础上,研究人员提出了一类新的随机特征,提供了 softmax kernel 的首个「positive and bounded」随机特征近似,并且在序列长度上的计算是线性的。

训练效率

高效的优化方法是现代 ML 应用程序的基石,在大规模设置中,这一点尤其重要。在这种设置下,即使是像 Adam 这样的一阶自适应方法通常也很昂贵,并且训练稳定性面临重重挑战。此外,这些方法通常对神经网络的架构不可知,从而忽略了架构的丰富性,导致训练效率低下。这也促使新技术不断被提出以更有效地优化现代神经网络模型。研究人员正在开发新的架构感知训练技术,例如,用于训练 Transformer 网络的一些研究,包括新的规模不变的 Transformer 网络和新的剪枝方法,并与随机梯度下降(SGD)结合使用,以加快训练进程。在该方法的帮助下,研究人员第一次能够使用简单的 SGD 有效地训练 BERT,而不需要自适应。

论文地址:https://arxiv.org/pdf/2210.05758.pdf

此外,研究人员在 LocoProp 的帮助下提出了一种新的方法 —— 在使用与一阶优化器相同的计算和内存资源的同时,实现与二阶优化器类似的性能。LocoProp 采用模块化的神经网络视图,将它们分解成层的组合。然后允许每一层都有自己的损失函数以及输出目标和权重正则化器。有了这个设置,经过适当的前后传递后,LocoProp 继续对每一层的局部损失进行并行更新。事实上,无论是理论上还是经验上,这些更新可以被证明类似于那些高阶优化器。在深度自编码器基准上,LocoProp 实现了与高阶优化器相当的性能,同时更具速度优势。

论文链接:https://proceedings.mlr.press/v151/amid22a.html

与反向传播类似,LocoProp 应用前向传递来计算激活。在向后传递中,LocoProp 为每一层设置每个神经元目标。最后,LocoProp 将模型训练拆分为跨层的独立问题,其中几个本地更新可以并行应用于每个层的权重。

SGD 等优化器的核心思想是,每个数据点从分布中独立且相同地采样。可惜这在实际环境中很难满足,比如强化学习,在这种情况下,模型(或智能体)必须从基于自己预测生成的数据中学习。研究人员提出了一种新的基于反向经验重放的 SGD 算法,该算法可以在线性动力系统、非线性动力系统和 Q-learning 中找到最优解。此外,已经有研究证明该方法的增强版本 IER 是目前最先进的版本,并且是在各种流行的 RL 基准测试中最稳定的体验重放技术。

论文地址:https://arxiv.org/pdf/2103.05896.pdf

数据效率

在许多任务中,深度神经网络严重依赖于大型数据集。除了大型数据集带来的存储成本和潜在的安全 / 隐私问题外,在此类数据集上训练现代深度神经网络还会产生很高的计算成本。解决这个问题的可行方法之一是对数据子集进行选择。

研究人员分析了子集选择框架,设计用于实际批处理设置中的任意模型族。在这种情况下,学习器可以一次采样一个示例,同时访问上下文和 true 标签,但为了限制开销,只有在选择了足够多的示例批次后才能更新其状态(即进一步的训练模型权重)。研究人员开发了一种算法,称为 IWeS,它通过重要性抽样来选择示例,其中分配给每个示例的抽样概率是基于在先前选择的批次上训练的模型的熵。研究所提供的理论分析证明了泛化和抽样率的界限。

论文地址:https://arxiv.org/pdf/2301.12052.pdf

训练大型网络的另一个问题是,它们可能对训练数据和部署时看到的数据之间的分布变化高度敏感,特别是在使用有限数量的训练数据时,这些数据可能无法覆盖所有部署时场景。最近的一项研究假设「极端简单性偏差」是神经网络这种脆弱性背后的关键问题,其使这一假设成为可行,导致了两种新的互补方法 ——DAFT 和 FRR—— 结合在一起时,可以提供明显更鲁棒的神经网络。特别是,这两种方法使用对抗性微调以及反向特征预测来加强学习网络。

论文地址:https://arxiv.org/pdf/2006.07710.pdf

推理效率

事实证明,增加神经网络的规模能够提高其预测准确性,然而,在现实世界中实现这些收益是具有挑战性的,因为大型模型的推理成本对于部署来说非常高。这促使策略提高服务效率,而不牺牲准确性。在 2022 年,专家研究了实现这一目标的不同策略,特别是基于知识蒸馏和自适应计算的策略。

蒸馏

蒸馏是一种简单而有效的模型压缩方法,极大地扩展了大型神经模型的潜在适用性。已有研究证明蒸馏能在广告推荐等一系列实际应用中发挥其作用。蒸馏的大多数用例涉及基本配方在给定领域的直接应用,对何时以及为什么这应该起作用的理解有限。谷歌今年的研究着眼于针对特定环境定制蒸馏,并正式研究了控制蒸馏成功的因素。

在算法方面,研究通过仔细建模教师标签中的噪声,开发出了一项重新加权训练示例的重要途径,以及一项有效措施来对数据子集进行采样以获得教师标签。谷歌在《Teacher Guided Training: An Efficient Framework for Knowledge Transfer》中表明:不是被动地使用教师来注释固定的数据集,而是主动地使用教师来指导选择要注释的信息性样本。这使得蒸馏过程在有限的数据或长尾设置中脱颖而出。

论文地址:https://arxiv.org/pdf/2208.06825.pdf

除此之外,谷歌还研究了从交叉编码器 (dual-encoder, 例如 BERT) 到因子双编码器(dual-encoder)的新方法,这也是对(query, document)对的相关性进行评分的重要设置。研究人员探讨了交叉编码器和双编码器之间性能差距的原因,注意到这可能是泛化的结果,而不是双编码器的容量限制。精馏损失函数的精心构造可以缓解这种情况,并减少交叉编码器和双编码器性能之间的差距。随后,在 embedtitil 中,研究通过匹配教师模型中的嵌入来进一步改进双编码器蒸馏。这种策略也可以用于从大到小的双编码器模型中提取信息,其中继承和冻结教师的文档嵌入可以证明是非常有效的。

论文地址:https://arxiv.org/pdf/2301.12005.pdf

理论方面,研究从监督复杂性角度出发,提供了一个关于蒸馏的新视角,这是一种衡量学生预测教师标签程度的方法。NTK(neural tangent kernel )理论提供了概念性的见解。研究进一步证明,蒸馏会导致学生不适合教师模型认为难以建模的点。直观地说,这可以帮助学生将有限的能力集中在那些可以合理建模的样本上。

论文地址:https://arxiv.org/pdf/2301.12245.pdf

自适应计算

虽然蒸馏是一种降低推理成本的有效手段,但它在所有样本上都是一致的。然而,直观地说,一些简单(easy)样本可能天生就比困难(hard)样本需要更少的计算。自适应计算的目标是设计能够实现这种依赖于样本的计算的机制。

CALM(Confident Adaptive Language Modeling)为基于 Transformer 的文本生成器(如 T5)引入了受控的早期退出(early-exit)功能。

论文地址:https://arxiv.org/pdf/2207.07061.pdf

在这种形式的自适应计算中,模型动态地修改每个解码步骤使用的 Transformer 层数。早期退出门使用带有决策阈值的置信度测量,该决策阈值经过校准,以满足统计性能保证。通过这种方式,模型只需要为最具挑战性的预测计算解码器层的完整堆栈。更简单的预测只需要计算几个解码器层。在实践中,该模型平均使用大约三分之一的层进行预测,在保持相同水平的生成质量的同时,速度能提升 2-3 倍。

使用常规语言模型(top)和 CALM (bottom)生成文本。CALM 试图做出早期预测。一旦对生成的内容足够自信(深蓝色调),它就会跳过来节省时间。

一种流行的自适应计算机制是两个或多个基本模型的级联。使用级联的一个关键问题:是简单地使用当前模型的预测,还是将预测推迟到下游模型。学习何时延迟需要设计一个合适的损失函数,它可以利用适当的信号作为延迟决策的监督。为了实现这一目标,研究人员正式研究了现有的损失函数,证明由于隐含的标签平滑应用,它们可能不适合训练样本。研究展示了可以通过延迟规则的 post-hoc 训练来缓解这种情况,这并不需要以任何方式修改模型内部。

论文地址:https://openreview.net/pdf?id=_jg6Sf6tuF7

对于检索应用,标准语义搜索技术对大型模型生成的每个嵌入使用固定表示。也就是说,无论下游任务及其相关的计算环境或约束如何,表示的大小和能力基本上是固定的。MRL(Matryoshka representation learning)引入了根据部署环境调整表示法的灵活性。当与标准的近似最近邻搜索技术(如 ScaNN)结合使用时,MRL 能够提供高达 16 倍的低计算,同时具有相同的召回率和准确率指标。

论文地址:https://openreview.net/pdf?id=9njZa1fm35

原文链接:https://ai.googleblog.com/2023/02/google-research-2022-beyond-algorithms.html?m=1#ToC

这是一份全面、系统且高质量的 ChatGPT 文章合集,我们筛选出来了 89 篇相关文章,设计了阅读框架与学习路径,大家可以根据自己的需求进行浏览与研读。合集内容包括:

ChatGPT 及 OpenAI 大事件时间轴

概念·真正搞懂 ChatGPT:共 3 篇文章

研究·GPT 家族更迭:共 16 篇文章

八年·OpenAI 的历史与现在:共 13 篇文章

干货·GPT 相关研究与技术:共 18 篇文章

观点·专家谈 ChatGPT:共 8 篇文章

行业·应用与探索:共 23 篇文章

行业·同类产品:共 8 篇文章

点击阅读原文,开始学习ChatGPT。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:content@jiqizhixin.com

关注公众号:拾黑(shiheibook)了解更多

[广告]赞助链接:

四季很好,只要有你,文娱排行榜:https://www.yaopaiming.com/

让资讯触达的更精准有趣:https://www.0xu.cn/

关注网络尖刀微信公众号

关注网络尖刀微信公众号随时掌握互联网精彩

- 1 习近平同马克龙交流互动的经典瞬间 7904780

- 2 黑龙江水库冰面下现13匹冰冻马 7808681

- 3 微信表情包戒烟再度翻红 7713551

- 4 2025你的消费习惯“更新”了吗 7617347

- 5 三星堆与秦始皇帝陵竟有联系 7522077

- 6 为啥今年流感如此厉害 7428164

- 7 劲酒如何成了年轻女性的神仙水 7331492

- 8 一身塑料过冬?聚酯纤维真是塑料瓶吗 7236168

- 9 15岁高中生网购日军侵华史料捐出 7142214

- 10 中疾控流感防治七问七答 7047469

![Whitebunny_ 绫的睡衣很可[中国赞] ](https://imgs.knowsafe.com:8087/img/aideep/2023/7/10/b9ba2e8bef8bb88894350b8799bd7953.jpg?w=250)

机器之心

机器之心